Mit der Vorstellung der Olympus E-M 5 MK II horchte man auf, den die Kamera bot bei 16 MPix einen Modus für Aufnahmen mit 40 MPix. Mit der erst kürzlich vorgestellten Panasonic G9, die nativ 20 MPix bietet, kommt eine weitere Kamera hinzu, die diesen HiRes Modus und zwar mit 80MPix anbietet.

Ein Marketing Gag ?

Da ich keine der beiden Kameras besitze mussten die veröffentlichten Bildbeispiele zur Beurteilung reichen. Die Aufnahmen in diesem HiRes Modus schienen zwar etwas mehr Details zu bieten, aber richtig überzeugen können sie eigentlich nicht.

Olympus hatte schon immer die Bildstabilisierung im Gehäuse und nicht in den Objektiven vorgesehen, Panasonic ist dort aber z.B. mit der Lumix G81 nachgezogen. Dabei wird zur Bildstabilisierung auch der Sensor im Gehäuse leicht bewegt, um so Bewegung des Nutzers auszugleichen. Dass funktioniert bei der Lumix recht gut, so dass es mir tatsächlich schon einmal gelungen ist, mit etwas Abstützung ein Bild mit 1sec. Belichtungszeit freihand hinzubekommen.

Diese Bewegungsmöglichkeit wird aber nun auch dazu benutzt, diesen HiRes Modus zu realisieren, in dem man eine Vielzahl von Aufnahmen macht, die im Pixelbereich gegeneinander verschoben sind und dann Kamera intern zu einem Bild verrechnet werden.

Die Technik

Bei den Kamera interne HiRes Modi wird die Verwendung eines Statives empfohlen. Bewegen sich zwischen den Belichtungen Objekte, wie z.B. Autos, Menschen gibt das kaum reparierbare Überlagerungen, so dass sich die Methode grundsätzlich nur für statische Motive eignet. Anfang 2015 wurde die Superresolution Methode von Ian Normann vorgestellt und Petapixel hat diesen Artikel 1:1 übernommen, ohne einmal eigene Versuche mit dieser Methode durchzuführen.

Hier wird Photoshop benötigt und da man ja die Kamera auf einem Stativ nicht pixelgenau verschieben kann, wird hier die Freihand Aufnahme mit einer hohen Serienbildfrequenz empfohlen. Selbst mit einer ruhigen Hand und 6-8 Bildern/sec. bewegt man sich, so dass die resultierenden Aufnahmen gegeneinander verschoben sind. Das Problem mit den sich bewegenden Objekten ist allerdings hier das gleiche.

Die Umsetzung mit jeder Kamera

Aufgrund der Aussagen in dem Artikel habe ich es einfach einmal ausprobiert, und sowohl mit der Lumix G81 und der Canon 5D MK II freihand eine Bildserie aufgenommen, die dann Basis für die weitere Bearbeitung ist. An der Lumix wurde das Panasonic 2.8/12-35mm und an der Canon wurde das Canon 4.0/24-70mm IS verwendet. Beide Objektive wurden um 2 Blendenstufen abgeblendet, um eine möglichst optimale Auflösung zu erzielen.

Aufgrund der Aussagen in dem Artikel habe ich es einfach einmal ausprobiert, und sowohl mit der Lumix G81 und der Canon 5D MK II freihand eine Bildserie aufgenommen, die dann Basis für die weitere Bearbeitung ist. An der Lumix wurde das Panasonic 2.8/12-35mm und an der Canon wurde das Canon 4.0/24-70mm IS verwendet. Beide Objektive wurden um 2 Blendenstufen abgeblendet, um eine möglichst optimale Auflösung zu erzielen.

Würde die beschrieben Methode funktionieren müsste ich bei der Lumix zu einer knapp 64MPix und bei der Canon knapp über 80MPix erreichen, und würde in beiden Fällen z.B. die Canon 5Ds(R) übertrumpfen ;-). Dann aber würden die Kamerahersteller solche MPix Boliden de facto nicht mehr verkaufen 😉

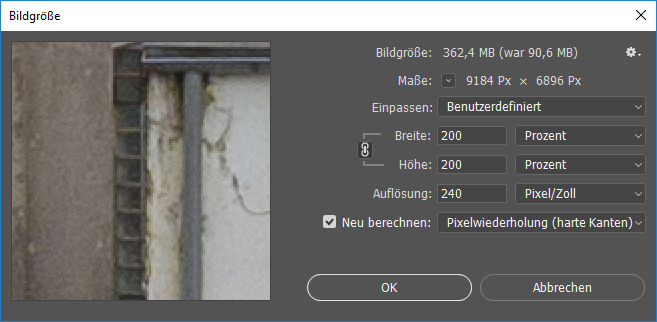

Die RAW-Dateien werden nun in Photoshop CC in Ebenen geladen. Hier kann man sehr schön durch das Ausblenden einzelner Ebenen sehr schön kontrollieren, dass die einzelnen Bilder gegeneinander verschoben sind, wenn auch nur geringfügig. Danach wird für jede einzelne Ebene die Größe um 200% vergrößert.

Ich habe mal ein kleines Video erstellt, dass die Vorgehensweise beschreibt:

10 oder mehr Aufnahmen als Ebenen zu laden und dann anschließend zu vergrößern erfordert aber RAM, bei mir waren es je nach Aufnahme zwischen 18 und 22GB RAM (Dazu kamen noch mehr als 2,5 GB von der Grafikkarte). Die Ebenen zu mitteln dauert recht lange, hier ist, wenn man Interesse an dem Verfahren hat der Weg dies über den Deckungsgrad der einzelnen Ebenen zu regeln schneller. Da hier ein SmartObjekt angelegt wird und möchte ich das speichern, dass später noch einmal Änderungen vorgenommen werden können, sind da sehr schnell 2-4 GB große Dateien vorhanden.

Ergebnisse

Zunächst erreiche mit dieser Methode rein nominell, dass bei der Lumix anstatt 4.592×3.448 px solche in einer Größe von 9.190×6.941 px herauskommen (bei der Canon 5D MK II 5.616×3744 px zu 11.304x7531px), aber wie sehen die Ergebnisse aus.

Bereits im direktem Vergleich z.B. in Photoshop stellt man fest, dass bei einer 100% Ansicht die hochgerechnete Variante nicht so detailreich und scharf aussieht wie die normale Aufnahme bei 100% (allerdings ist bei der hochgerechneten Aufnahme der Ausschnitt kleiner)

Das Ergebnis bleibt auch so, wenn man einmal in Details hineinzoomt:

Das Ergebnis bleibt auch so, wenn man einmal in Details hineinzoomt:

Wenn man jetzt einwenden mag, dass die Lumix G81 wegen des kleinen Sensors oder aufgrund des Objektives vielleicht weniger geeignet ist (aber warum wird es den bei mFT Kamera eingebaut ?), dann kann ich beruhigen, bei der Vollformat Canon sieht das Ergebnis nicht anders aus.

Doch nur Hype?

Das diese Methode keine Ergebnisse erzeugt, die dann mit Kameras mithalten kann, die 50 oder mehr Megapixel auflösen, war klar. Und vielleicht arbeitet die in den Kameras implementierte Methode auch exakter mit entsprechend besseren Ergebnissen , aber ich würde die Methode nicht verteufeln wollen. Man erreicht zwar kaum mehr sichtbare Details, aber unter Beibehaltung aller Details die Auflösung in Pixeln vergrößern zu können, halte ich schon für interessant, wenn man z.B. für eine große Ausbelichtung einfach mehr Pixel benötigt.

Was denkt ihr über diese Methode oder benutzt ihr vielleicht entsprechende Programme bei Olympus oder Panasonic Kameras?

ciao tuxoche